ChatGPT’nin arkasındaki teknolojiyi sıfırdan başlayıp “bunu partide bile anlatırım” seviyesine kadar anlamak için lafügüzaf olmayan bir rehber

ChatGPT’nin arkasındaki teknolojiyi sıfırdan başlayıp “bunu partide bile anlatırım” seviyesine kadar anlamak için lafügüzaf olmayan bir rehber ChatGPT’yi kullandın. Belki ağzın açık kaldı. Belki de ödün koptu. Ama

ChatGPT’nin arkasındaki teknolojiyi sıfırdan başlayıp “bunu partide bile anlatırım” seviyesine kadar anlamak için lafügüzaf olmayan bir rehber

ChatGPT’yi kullandın. Belki ağzın açık kaldı. Belki de ödün koptu. Ama GPT’nin ne olduğunu gerçekten biliyor musun? Pazarlama diliyle değil. “AI sihir işte” diye geçiştirerek değil. Gerçek teknolojisiyle.

Hadi bunu düzeltelim.

Bu yazının sonunda GPT’yi üç seviyede anlayacaksın:

- Başlangıç: Nedir ve neden önemli

- Orta seviye: Kaputun altında aslında nasıl çalışıyor

- İleri seviye: Teknik evrimi ve sırada ne var

PhD gerekmiyor. Sadece merak.

Seviye 1: “Annem de anlasın” versiyonu

Peki GPT tam olarak nedir?

GPT, “Generative Pre-trained Transformer”ın kısaltması; AI sohbet botlarında kullanılan bir tür büyük dil modeli (LLM). Ama parçalara ayırmadan bu tanım pek bir işe yaramaz.

Generative (Üretken): Yeni içerik üretir. Sen bir komut verirsin, o metin (yeni sürümlerde görsel ya da ses) üretir. Hazır cevapları bir veritabanından aramıyor—cevabı gerçekten kelime kelime kuruyor.

Pre-trained (Önceden eğitilmiş): Kimse kullanmadan önce, internetten, kitaplardan ve başka kaynaklardan gelen devasa metinlerle zaten eğitilmiştir. İlk sınavına girmeden önce milyonlarca ders kitabı okumuş bir öğrenci gibi düşün.

Transformer: İşin gizli sosu—her şeyi çalışır hâle getiren temel mimari. Buna sonra geleceğiz; şimdilik bilmen gereken, bağlamı anlamada aşırı iyi, dili işlemek için özel bir yöntem olduğu.

Neden umurunda olsun?

GPT’ler, etiketlenmemiş büyük veri kümeleriyle önceden eğitilen ve yepyeni içerik üretebilen bir derin öğrenme mimarisine dayanır. Bu, gazı köklenmiş bir otomatik tamamlama değil. Öncekilerden kökten farklı bir şey.

Geleneksel yazılım kuralları izler: EĞER kullanıcı X yazarsa, O ZAMAN Y göster.

GPT’ler kalıp öğrenir: “Milyarlarca örneğe göre, biri X sorduğunda Y’ye benzeyen cevaplar genelde işe yarıyor.”

Bu yüzden ChatGPT şunları yapabilir:

- Açıkça programlanmadığı dillerde bile kod yazmak

- Kuantum fiziğini 5. sınıf seviyesinde anlatmak

- Python hatalarını ayıklamak

- Kötü olmayan şiir yazmak (bazen)

Daha önce hiç görmediğimiz ölçekte bir örüntü tanıma bu.

Tek cümlelik özet

GPT, internetin kayda değer bir kısmını okuyarak insan dilini anlamayı ve üretmeyi öğrenmiş bir AI’dır; artık da metin tabanlı neredeyse her işte sana yardım edebilir.

Seviye 2: “Bunu gerçekten anlamak istiyorum” versiyonu

Tamam, temeli kaptın. Şimdi motor odasında kaybolmadan kaputu aralayalım.

Üç adımlı yolculuk: GPT nasıl öğrenir?

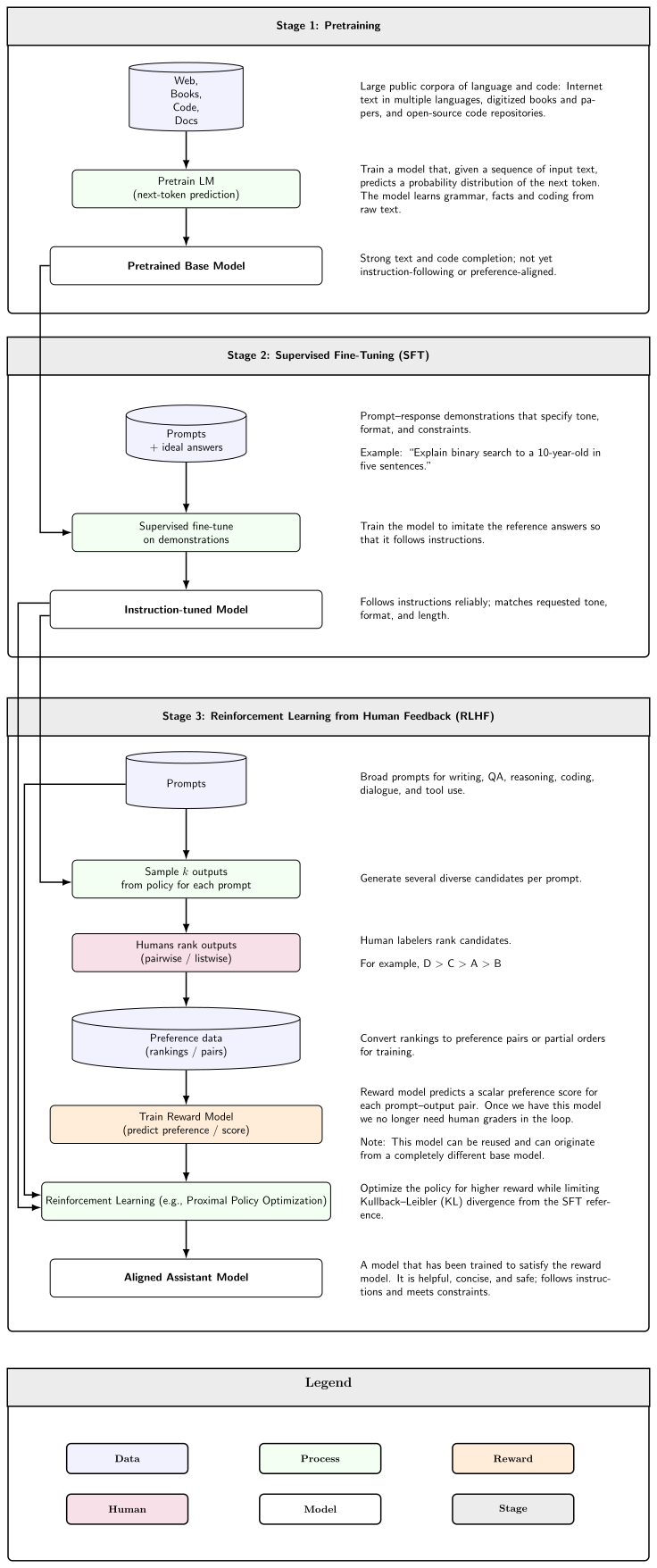

Adım 1: Ön eğitim (Okuma evresi)

Üretken ön eğitim (GP), bir modelin önce büyük, etiketlenmemiş bir veri kümesinde eğitilip veri noktaları üretmeyi öğrendiği bir tür öz-denetimli öğrenmedir.

Birini Wikipedia’yı, Reddit’i, binlerce kitabı ve milyarlarca web sayfasını okumak için işe aldığını düşün. Tek görevi ne? Bir sonraki kelimeyi tahmin etmek.

“Kedi ___ üstüne oturdu”

Kolay, değil mi? Muhtemelen “minder”, “sandalye” ya da “masa.”

“Kuantum süperpozisyonu ___ olduğunda çöktü”

Daha zor. Ama yeterince fizik kitabı okuduysan, iyi bir tahmin yaparsın.

GPT bunu trilyonlarca kez, giderek artan karmaşıklıkta yapar. Cevap ezberlemiyor—dilin istatistiksel örüntülerini öğreniyor. Kelimelerin birbirleriyle ilişkisini. Cümlelerin akışını. Argümanların nasıl kurulduğunu. Kodun nasıl yazıldığını.

Bu yüzden GPT-1, çeşitli bir metin derlemi olan BookCorpus üzerinde eğitildi; sonraki sürümler ise giderek daha büyük veri kümeleriyle eğitildi. Örneğin GPT-3’ün 175 milyar parametresi var—yani dili nasıl anladığını ince ayarlamak için 175 milyar “ayar düğmesi”.

Adım 2: İnce ayar (Uzmanlaşma evresi)

Ön eğitimden sonra, önceden eğitilmiş model etiketli bir veri kümesi kullanılarak belirli bir göreve uyarlanır (ince ayar adımı).

GPT’nin burada sadece doğru olmaktan çıkıp faydalı olmayı öğrenir. İnsan geri bildirimiyle şunlara göre eğitilir:

- Talimatları takip etmek

- Doğruyu söylemek (yani, en azından denemek)

- Zararlı istekleri reddetmek

- İstediğin tona uyum sağlamak

OpenAI, InstructGPT’yi tanıttı: Denetimli eğitim ve insan geri bildiriminden pekiştirmeli öğrenme (RLHF) ile talimat izlemek üzere ince ayarlanmış bir model serisi. ChatGPT’nin sadece Wikipedia maddesi kusmamasının sebebi bu—gerçekten sohbet etmeye ve yardımcı olmaya çalışıyor.

Adım 3: Dağıtım (Gerçek dünya evresi)

Sen soru yazarsın. GPT işler. Bir cevap üretir. Sen ya beğenirsin ya beğenmezsin. Bu geri bildirim döngüsü sistemi geliştirmeye devam eder.

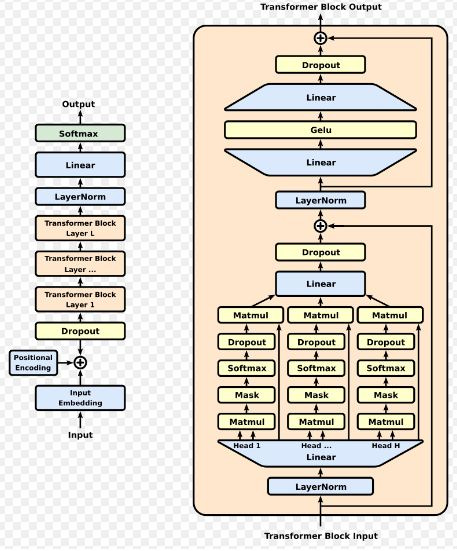

Transformer: Bu işin yürümesinin sebebi

Çoğu kişinin atladığı kısım şu: Transformer mimarisi olmasa GPT diye bir şey olmazdı.

Transformer mimarisi, Google’daki araştırmacıların 12 Haziran 2017’de yayımladığı “Attention Is All You Need” makalesiyle tanıtıldı.

Transformer’lardan önce AI modelleri metni sıralı işlerdi—kitabı baştan sona okur gibi kelime kelime. Bu hem yavaştı hem de uzun menzilli bağımlılıklarda zorlanırdı (50 kelime önce ne dendiğini hatırlamak gibi).

Transformer’lar “attention mechanisms” denen şeyi getirdi. Kelimeleri sırayla işlemek yerine, attention mekanizması sayesinde modeller tüm metin dizisini aynı anda işleyebilir; böylece çok daha büyük ve sofistike modelleri eğitmek mümkün olur.

Şöyle düşün:

Eski yöntem: Bir polisiye romanı kelime kelime okuyup katilin kim olduğunu akılda tutmaya çalışmak.

Transformer yöntemi: Tüm sayfayı aynı anda görebilmek ve hikâyenin başı ile sonundaki ipuçlarını anında bağlamak.

Bu, devasa veri kümeleriyle eğitimi mümkün kıldı. Modellerin bağlamı daha iyi anlamasını sağladı. GPT’yi mümkün kıldı.

GPT neden yanlış yapıyor (ve bunun bize söylediği şey)

GPT sihir değil. İstatistik. Çok sofistike istatistik, ama sonuçta istatistik.

Ona bir soru sorduğunda, senin düşündüğün şekilde “düşünmüyor.” Olasılık hesaplıyor: “Bu girdiden sonra gelmesi en muhtemel kelime dizisi ne?”

Bu yüzden:

- Bazen kulağa inandırıcı gelen uydurma bilgiler üretir (“hallucinations” denir)

- Kendinden emin şekilde yanlış olabilir

- Eklentiler olmadan matematikte zorlanabilir

- Aslında hiçbir şeyi gerçekten “bilmez”—tahmin eder

Ama bu aynı zamanda onu bu kadar esnek yapar. Her görev için tek tek programlanmaya ihtiyaç duymaz. Sadece örüntülere ihtiyaç duyar.

Seviye 3: “Tam teknik hikâyeyi istiyorum” versiyonu

Tamam, detaylara girelim. Evrim, rekabet ve gelecek burada.

Evrim: GPT-1’den GPT-5’e

GPT-1 (Haziran 2018): OpenAI, transformer tabanlı bir büyük dil modeli olarak tasarlanan ilk GPT modeli GPT-1’i tanıtan bir makale yayımladı. 117 milyon parametresi vardı. O dönem etkileyiciydi, bugünse mütevazı kalıyor.

GPT-2 (Şubat 2019): OpenAI, 1.5 milyar parametreli ve WebText üzerinde eğitilmiş daha büyük bir model olan GPT-2’yi tanıttı; WebText, 8 milyon web sayfasından oluşan 40 GB’lık bir veri setiydi. OpenAI, kötüye kullanım endişeleriyle tam sürümü bir süre erteledi. Model, insan yazmış gibi duran tutarlı paragraflar üretebiliyordu.

GPT-3 (Mayıs 2020): Oyunu değiştiren model. GPT-3 175 milyar parametreye sahipti ve few-shot ve zero-shot öğrenme yeteneklerinde büyük bir sıçrama yaptı. Yani sadece komuttaki birkaç örnekten, açıkça eğitilmediği işleri bile yapabiliyordu.

GPT-3.5 ve ChatGPT (Kasım 2022): OpenAI’nin amiral gemisi sohbet botu ürünü ChatGPT, 30 Kasım 2022’de, ilk etapta GPT-3.5 tabanlı olarak çıktı. Dünyanın fark ettiği an buydu. Teknoloji kökten farklı olduğu için değil; OpenAI onu konuşmalı bir arayüzle erişilebilir kıldığı için.

GPT-4 (Mart 2023): GPT-4, 14 Mart 2023’te yayımlandı ve daha sonra Microsoft Copilot, GitHub Copilot, Snapchat, Khan Academy ve Duolingo dahil olmak üzere çeşitli uygulamaların bazı bölümlerine entegre edildi. Çok modlu hâle geldi—hem metni hem görselleri işleyebiliyordu.

GPT-4o ve ötesi: GPT-4o; metin, görsel ve sesi hem işleyebilir hem de üretebilir. “o”, “omni” demek; yani birden fazla veri türünü idare ediyor.

GPT-5 (Ağustos 2025): OpenAI, göreve göre daha hızlı bir modeli mi yoksa daha yavaş bir akıl yürütme modelini mi kullanacağını otomatik seçen bir yönlendirici (router) içeren GPT-5’i yayımladı. Bu, farklı problemlerde doğru yaklaşımı seçen uyarlanabilir AI’a doğru bir kaymayı gösteriyor.

Rekabet: Sadece OpenAI yok

ChatGPT patladığı an herkes oyuna girmek istedi:

Google: Google, PaLM ve Gemini’yi geliştirdi; ayrıca rakip sohbet botu Gemini’yi de çıkardı (başta, konuşma için eğitilmiş dil modelleri ailesi LaMDA’ya dayanıyordu).

Meta: Meta AI’ın LLaMA adlı, üretken transformer tabanlı bir temel büyük dil modeli var.

Açık kaynak: EleutherAI, 2021’de GPT-J dahil bir dizi açık ağırlıklı model yayımladı.

Yarış başladı. Sadece daha iyi sohbet botları için değil; müşteri hizmetlerinden ilaç keşfine kadar her şeyi çalıştırabilecek temel modeller için.

Özelleşmiş GPT’ler: Genel sohbetin ötesi

İşin ilginçleştiği yer burası. Temel modeller, belirli alanlara uyarlanıyor:

Satış ve pazarlama alanlarında, müşteri ilişkileri yönetimine yardımcı olmak için EinsteinGPT

Finans alanında, finans haberleri ve bilgisine yardımcı olmak için BloombergGPT

Eğitim alanında, doğrudan cevap vermeden öğrencileri yönlendirerek ders çalıştırmak için Khanmigo

Biyomedikal alanda, biyomedikal literatür metni üretimi ve madenciliğine yardımcı olmak için BioGPT

Kalıp şu: Bir temel modeli al, alanına özel veriyle ince ayar yap, hop—alanının jargonunu ve nüanslarını anlayan bir uzman sistem elde et.

Akıl yürütme modelleri: Sıradaki cephe

En ileri nokta şu: o3 ve DeepSeek R1 gibi GPT modelleri, nihai cevabı vermeden önce çok adımlı chain-of-thought akıl yürütmesi üretecek şekilde pekiştirmeli öğrenmeyle eğitildi; bu da matematik gibi alanlarda karmaşık problemleri çözmeye yardımcı oluyor.

Bu modeller, hemen cevabı yapıştırmak yerine problemleri adım adım “düşünerek” ilerler. Daha yavaştırlar ama karmaşık işlerde daha isabetlidirler.

Bu, “gazı köklenmiş otomatik tamamlama”dan “problemleri gerçekten akıl yürüterek çözme”ye evrimdir. İnsan seviyesinde akıl yürütme değil—henüz—ama ciddi bir adım.

Kimsenin konuşmadığı teknik zorluklar

Ölçek pahalıdır: GPT-3’ü eğitmek milyonlarca dolara mal olur. GPT-4 muhtemelen on milyonlarca dolardır. Hesaplama gereksinimleri akıl almaz düzeyde.

Hizalama zordur: Bu modellerin bizim istediğimiz gibi (yardımcı, zararsız, dürüst) davranmasını sağlamak hâlâ süren bir araştırma problemidir. RLHF yardımcı olur ama kusursuz değildir.

Halüsinasyonlar sürer: GPT’nin gerçeği değil, kulağa makul gelen metni tahmin etmesi temel sorunu çözülemedi. Azaldı ama bitmedi.

Önyargı verinin içinde gelir: İnternet verisiyle eğitirsen internet önyargılarını da alırsın. Bunu azaltmak için çalışmalar var, ama doğası gereği zor bir mesele.

Sırada ne var?

Her şey çok modlu: Metin, görsel, ses, video ve hatta muhtemelen sensör verisini sorunsuzca ele alan modeller.

Daha uzun bağlam pencereleri: Şu an modeller aynı anda birkaç bin kelimeyi “hatırlayabiliyor.” Gelecekteki modeller bağlam olarak bütün kitapları ele alacak.

Daha iyi akıl yürütme: Daha sofistike chain of thought. Gerçekten plan yapıp strateji kurabilen modeller.

Özelleşmiş modeller: Tek bir dev genel model yerine, birlikte çalışan uzmanlaşmış model ekosistemleri göreceğiz.

Edge dağıtımı: Bu modelleri bulut yerine telefonda ya da dizüstünde çalıştırmak. Gizlilik, hız ve maliyet avantajları.

Son söz

GPT sihir değil. Bilinçli değil. Yarın işini elinden almayacak (muhtemelen).

Daha önce hiç denemediğimiz ölçekte insan diliyle eğitilmiş, aşırı sofistike bir örüntü eşleştirme sistemi. Gerçekten faydalı. Hakikaten etkileyici. Ve bilgisayarlarla nasıl etkileştiğimizi değiştirecek.

Ama onun gerçekte ne olduğunu—olası metin dizilerini tahmin eden istatistiksel bir model—anlamak, onu daha iyi kullanmanı sağlar. Güçlü yanlarını (esneklik, hız, bilgi genişliği) ve zayıf yanlarını (halüsinasyonlar, gerçek anlayışın olmaması, sınırlı akıl yürütme) bilirsin.

O yüzden bir dahaki sefere biri “GPT nedir?” diye sorduğunda, sadece “şu ChatGPT olayı” demeyeceksin. Milyarlarca metin örneğinden öğrenmiş, bağlamı anlamak için attention mechanisms kullanan ve son on yıldaki en büyük AI atılımlarından birini temsil eden üretken, önceden eğitilmiş bir transformer olduğunu bileceksin.

Daha fazlasını mı istiyorlar? Hazırda üç açıklama seviyen var.

Daha derine inmek ister misin? Araştırma makalelerinin hepsi herkese açık. Transformer’lar için “Attention Is All You Need” (2017) ile başla; sonra OpenAI’nin GPT-1, GPT-2 ve GPT-3 makalelerine geç. Uyarayım: yoğun metinler. Ama buraya kadar geldiysen, altından kalkarsın.

Paylaş

Okuduğun için teşekkürler! Yeni yazıları ücretsiz almak ve çalışmamı desteklemek için abone ol.

Yorumlar yalnızca üyelere açık. Saygılı ve yapıcı bir dil bekliyoruz.